Die KI-Landschaft ähnelt dem Wilden Westen: Alle probieren sich aus, kaum etwas ist reguliert. Doch Start-ups im Finanzsektor können es sich nicht erlauben, auf Gesetze zu warten. Sie sollten für die zukünftige Compliance schon heute auf vertrauenswürdige KI setzen. Erfahren Sie, was sich dahinter verbirgt und wie Investoren solche Start-ups bewerten.

Vertrauenswürdige KI im Finanzsektor: Ethik als Wettbewerbsvorteil

Vertrauenswürdigkeit und KI - wie kann Ethik auf Maschinen übertragen werden?

Eigentlich ist „vertrauenswürdige KI“ ein Oxymoron, also sprachlich gesehen ein Widerspruch. Diese Bezeichnung impliziert nämlich, dass Künstliche Intelligenz selbstständig ethische Entscheidungen trifft und vertrauenswürdig handeln kann. Das ist irreführend, da KI-Systeme von Menschen entwickelt werden und stets deren Vorurteile und Fehler widerspiegeln. Daher hängt das Vertrauen in KI nicht von der Technologie selbst ab, sondern von der Transparenz, Ethik und Verantwortlichkeit derjenigen, die sie entwickeln und einsetzen.

Grundsätzlich ist Vertrauen fragil: schwer zu gewinnen und kann leicht brüchig werden. Ähnlich wie in zwischenmenschlichen Beziehungen ist das Vertrauen in die Integrität und Zuverlässigkeit einer Maschine von entscheidender Bedeutung, doch viel schwieriger zu erlangen. Denn: In der Regel mangelt es an Transparenz, um einschätzen zu können, ob eine Maschine oder ein Algorithmus so entscheiden wird, dass es positive Auswirkungen auf die Gesellschaft hat. Daraus ergibt sich vor allem folgende Fragestellung: Wie bekommt man Ethik – also die Beschäftigung damit, was richtig und falsch ist im Verhalten von Menschen – auf die Maschine übertragen?

Als Investment-Manager bei neosfer beschäftige ich mich täglich mit Start-ups, die mit neuartigen Technologien bestehende Strukturen verbessern oder gar gänzlich ersetzen wollen. Hierbei ist es elementar, nicht nur den direkten potentiellen monetären Wertzuwachs des Investments zu betrachten, sondern auch die gesellschaftlichen Kosten, die sich daraus ergeben. Vernachlässigt man als Wagniskapitalgeber diese Prüfung, kann es leicht passieren, dass Technologien und Praktiken finanziert werden, die einen gesellschaftlichen Schaden mit sich ziehen. Ein Negativbeispiel für den schädlichen Einsatz künstlicher Intelligenz ist die Erstellung von Deepfakes, auf die sich unter anderem Google-CEO Sundar Pichai bezieht, wenn er sagt, dass er sich Sorgen um die zu schnelle Entwicklung von Künstlicher Intelligenz macht. Deepfakes sind mit Hilfe künstlicher Intelligenz erzeugte realistische, aber gefälschte Bild-, Audio- oder Videoinhalte, die Personen in irreführender oder schädigender Weise darstellen. Die Unterscheidung zwischen echten und manipulierten Inhalten stellt eine immer schwieriger werdende Problemstellung dar, da diese Inhalte einen gesellschaftlichen Schaden verursachen können.

Was macht eine KI vertrauenswürdig?

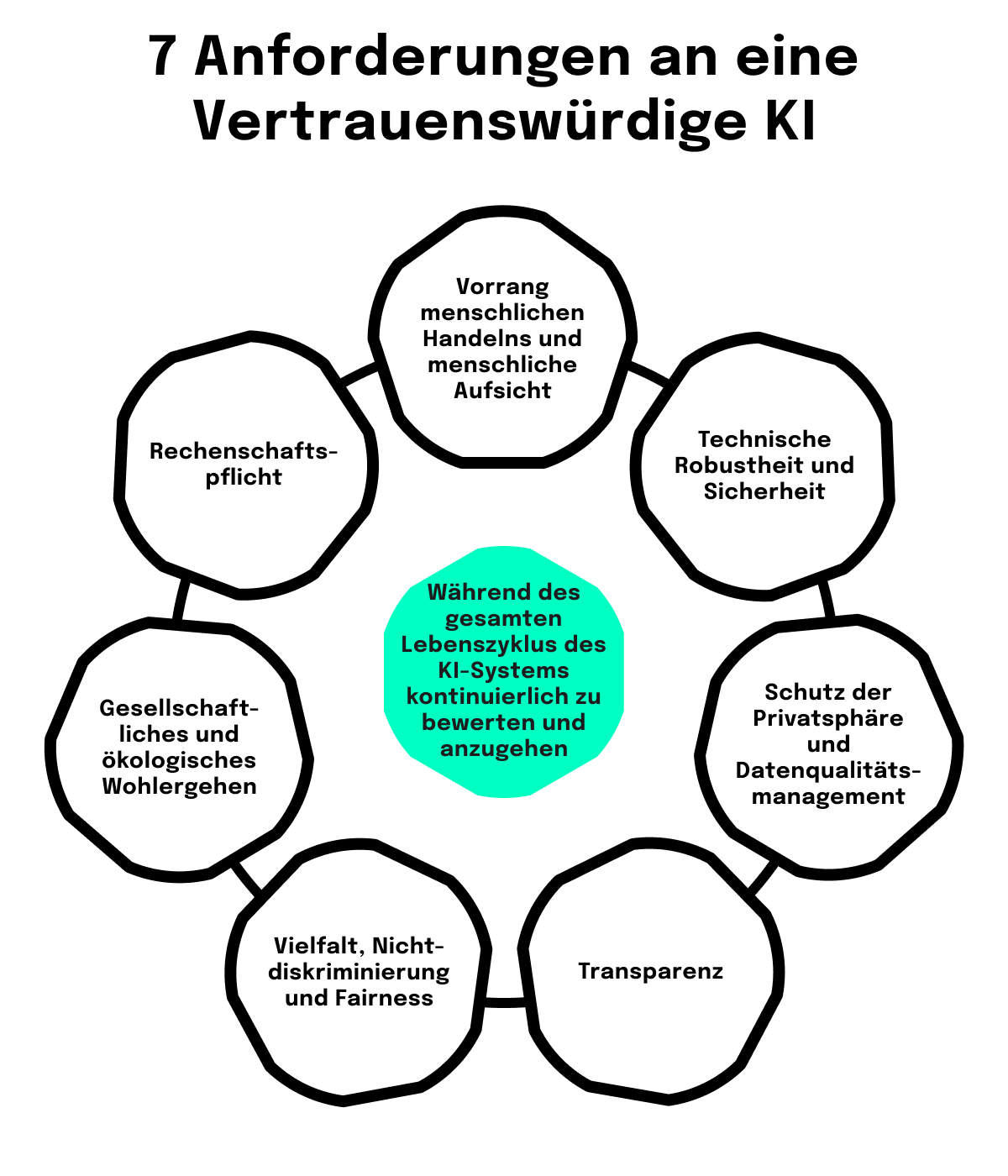

Damit eine KI vertrauenswürdig wird, braucht es mehr als ein paar einprogrammierte Regeln. Es braucht ethische Standards, auf die wir uns global einigen können – das klingt nach einem ziemlich unmöglichen Vorhaben. Allerdings gibt es einige Modelle wie beispielsweise diese sieben Anforderungen an eine vertrauenswürdige KI, welche die EU schon Jahre vor der Popularität von generativer KI formuliert hat. Sie sind bis heute sehr gute Leitplanken:

- Dass Menschen involviert sind: Die KI soll Menschen helfen, nicht sie ersetzen. Insofern sollen zu jedem Zeitpunkt die Aufsicht und die Autonomie der Menschen im Mittelpunkt der KI-Funktionalität stehen.

- Die KI muss robust und zuverlässig sein, d.h. sie muss zuverlässig verfügbar sein und immer mindestens so gute Ergebnisse liefern wie die Menschen, die sie ergänzen soll. Außerdem muss sie sicher vor allen Cybersecurity-Gefahren sein, um Vertrauenswürdigkeit zu haben.

- Datenschutz: Eine vertrauenswürdiges KI-System gewährt zu jeder Zeit die Privatsphäre der Nutzenden und gibt ihnen zum Beispiel auch die Möglichkeit für einen Opt-out beim Thema Speicherung.

- Sie muss transparent sein: Es muss jederzeit deutlich werden, dass eine KI am Werk ist, und sie muss den Prinzipien von „Explainable AI“ folgen, also Wissen darüber zur Verfügung stellen, wie sie zu einem Ergebnis gekommen ist.

- Gesellschaftliches und ökologisches Wohlergehen: Bei allem, was die KI betrifft, werden die Auswirkungen auf die Umwelt mitgedacht und es wird darauf geachtet, dass Menschen und anderen Lebewesen heute und in Zukunft kein Schaden zugefügt wird.

- Sie muss unbefangen und fair sein, insbesondere darf sie keine Vorurteile gegenüber marginalisierten, historisch diskriminierten Gruppen haben. Hierzu gehört auch ein barrierefreies Design.

- Es muss jederzeit klar sein, wer die Verantwortung und Haftung für die Ergebnisse einer KI trägt.

Diese ethischen Standards einzuhalten, ist kein technologisches Problem, sondern ein soziotechnisches, sagt Phaedra Boinodiris von IBM, eine bedeutende Stimme zum Thema KI und Ethik. Vor allem gehe es bei vertrauenswürdigen KI-Lösungen um Menschen: insbesondere diejenigen, die die KI entwickeln und unter anderem auf Transparenz und Zuverlässigkeit achten. Hierbei hilft es zum Beispiel in sich heterogene Teams zu formen, um all den menschlichen „Unconscious Bias“ – die uns oft nicht bewussten Vorurteile, die wir mit uns herumtragen – nicht auf die KI zu übertragen. Und es braucht die richtigen Menschen in Führungspositionen, die ebenfalls alle Dimensionen von vertrauenswürdigen KI-Systemen mitdenken und für eine entsprechende Governance einstehen.

Wilder Westen: Ethische Dilemmata und die Rolle des Menschen

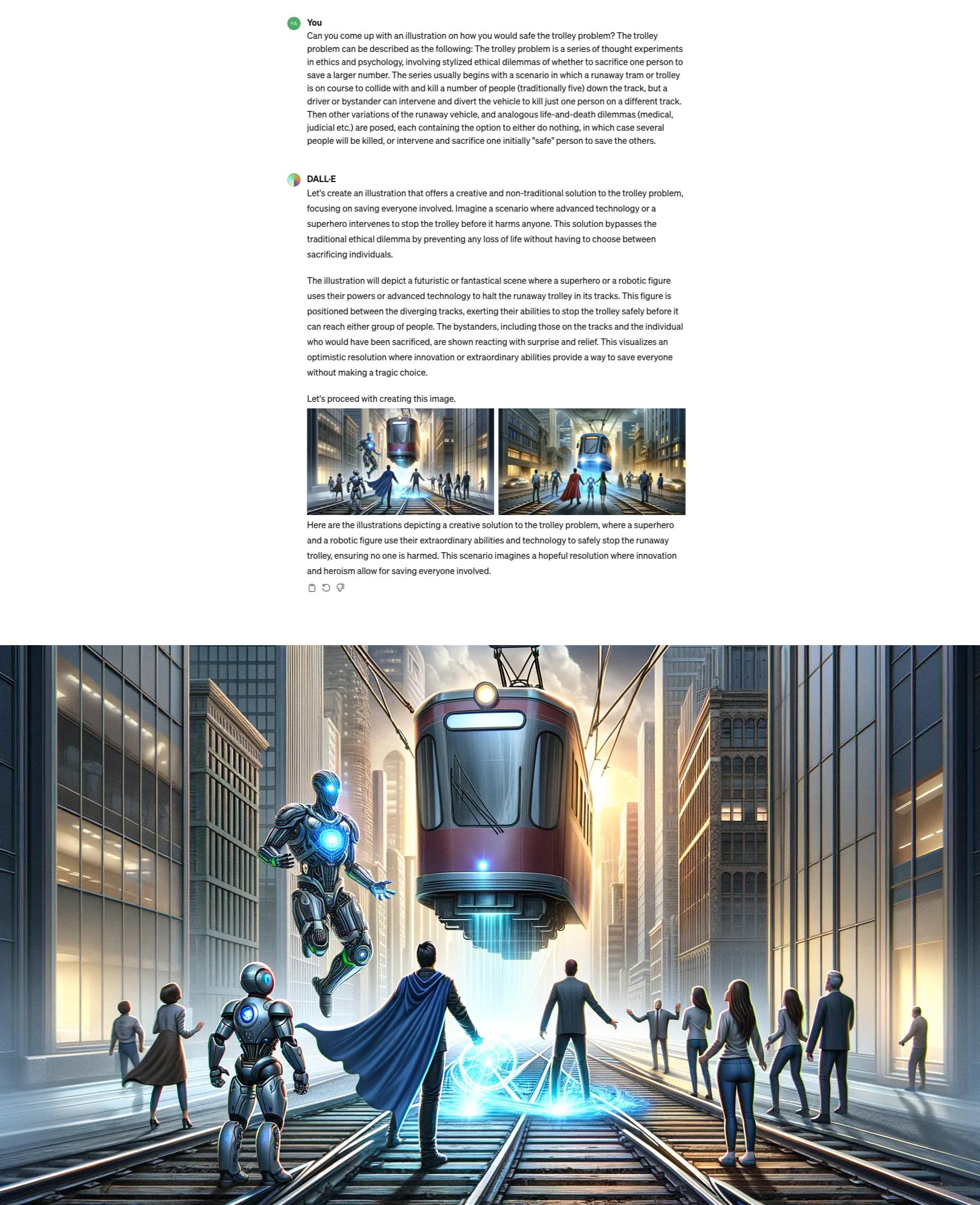

Wie wichtig der Mensch im gesamten KI-Thema ist, zeigt sich an ethischen Dilemmata. Diese sind schon schwierig genug, wenn ein Mensch sie in der jeweiligen Situation unter Zeitdruck lösen muss. Wie zum Beispiel das Trolley-Problem, ein berühmtes Gedankenexperiment, bei dem man sich entscheiden muss, ob man eine Weiche umstellt, damit ein Waggon einen Menschen anstelle einer ganzen Gruppe überfährt. Ich habe die generative Bild-KI DALL-E darum gebeten, zu illustrieren, wie sie das Trolley-Problem lösen würde. Hier ist das Ergebnis:

Auf Artificial Intelligence übertragen, ist das Beispiel übrigens ebenso plakativ: Wenn ein autonom fahrendes Auto in einer akuten Verkehrssituation entscheiden muss, ob es einen einzelnen Menschen überfährt oder eine ganze Gruppe, dann muss die Basis für diese Entscheidung programmiert werden. Wer ist dann am Ende des Tages für die Folgen eines solchen Unfalls mit Todesfolge verantwortlich? Für mich stellt sich eben dieser Diskurs zu diesen Fragen als eine der wichtigsten Grundlagen, um mit Künstlicher Intelligenz langfristig signifikante gesellschaftliche Effizienzgewinne zu realisieren.

Aktuell ist das Arbeiten mit KI noch ein bisschen „Wilder Westen“. Gerade die generative KI ist so neu, dass überall Anwendungen geprüft und ausprobiert werden und sich ständig neuartige Anwendungsbereiche ergeben. Hierfür gibt es weder gesellschaftliche Normen, noch Gesetze oder regulatorische Vorgaben. Die Basis für all das werden ethische Überlegungen sein: Ethik formt gesellschaftliche Normen – und die Gesetzgebung oder die Regulatorik speisen sich daraus.

Vertrauenswürdige KI im Finanzsektor: Warum sie in bestimmten Segmenten unverzichtbar ist

Wer heute KI in seinen Produkten einsetzt, sollte sich an den gängigen Frameworks als Ausgangspunkt orientieren. Prinzipien wie die der EU können eine angemessene Grundlage für Unternehmen sein.

Schlägt man die Brücke zum Finanzsektor mit seiner komplexen Regulatorik, ist es wichtig, sich jetzt schon größtmögliche Standards aufzuerlegen. Denn es gibt verschiedene Bereiche im Finanzsektor, in denen vertrauenswürdige KI unverzichtbar ist und sein wird:

- Beim Risikomanagement im Asset-Bereich werden Risiken, die mit Investitionen in Vermögenswerte verbunden sind, identifiziert, bewertet und gesteuert.

- In der Anlageberatung erhalten Kundinnen und Kunden klare Ratschläge und Empfehlungen zur optimalen Verteilung des eigenen Vermögens auf verschiedene Anlageklassen. Die Empfehlungen basieren auf einer gründlichen Analyse von Zielen und Risikobereitschaft.

- Geldwäscheprävention verhindert, dass illegale Gelder in den Finanzkreislauf gelangen und in legale Vermögenswerte umgewandelt werden.

- Zur Betrugsprävention und -aufklärung gehört, betrügerische Aktivitäten im Finanzsektor zu erkennen, zu verhindern und zu untersuchen.

- Datensicherheit und -schutz schützt Finanzdaten vor unbefugtem Zugriff, Missbrauch oder Diebstahl.

- Mit der Bonitätsbewertung wird die Kreditwürdigkeit von Einzelpersonen oder Unternehmen analysiert, um Kreditentscheidungen zu treffen.

- Cyber Security schützt Computersysteme, Netzwerke und Daten vor Cyber-Angriffen, Diebstahl oder Beschädigung.

- Im Hochfrequenzhandel werden Finanzinstrumente extrem schnell gekauft und verkauft.

Diese acht Bereiche haben eines gemeinsam: Künstliche Intelligenz trifft Entscheidungen autonom oder in Kombination mit menschlichen Entscheidungsträgerinnen und -trägern. In einem Kontext wie dem der Finanzdienstleistungen können Fehler leicht zu monetären Einbußen und Vertrauensbruch führen. Fehler gilt es also unbedingt zu vermeiden oder zumindest Fehlentscheidungen zu minimieren.

Aus diesem Grund wird zunehmend auf vertrauenswürdige KI gesetzt, die zwar kostenintensiver sein mag, sich aber durch eine geringere Fehlerquote und die Möglichkeit der Nachverfolgung von Fehlern auszeichnet. Dies ist für den Lernprozess aus Fehlern von grundlegender Bedeutung.

Entscheidungen mit KI im Finanzsektor sind in vielen Fällen Selektionsentscheidungen: Soll ich in diesen Vermögenswert investieren? Soll ich diese Transaktion wegen Terrorismusverdacht sperren? Soll ich dieser Kundin Zugang gewähren? Voreingenommenheit kann unschuldige Kundinnen und Kunden zu Unrecht verdächtigen oder sogar von Finanzdienstleistungen wie beispielsweise Krediten ausschließen. Dieses Problem betrifft menschliche und maschinelle Entscheidungen gleichermaßen. Umso wichtiger ist es, vertrauenswürdige KI einzusetzen, die diese Voreingenommenheit aufdeckt und nicht einfach übernimmt.

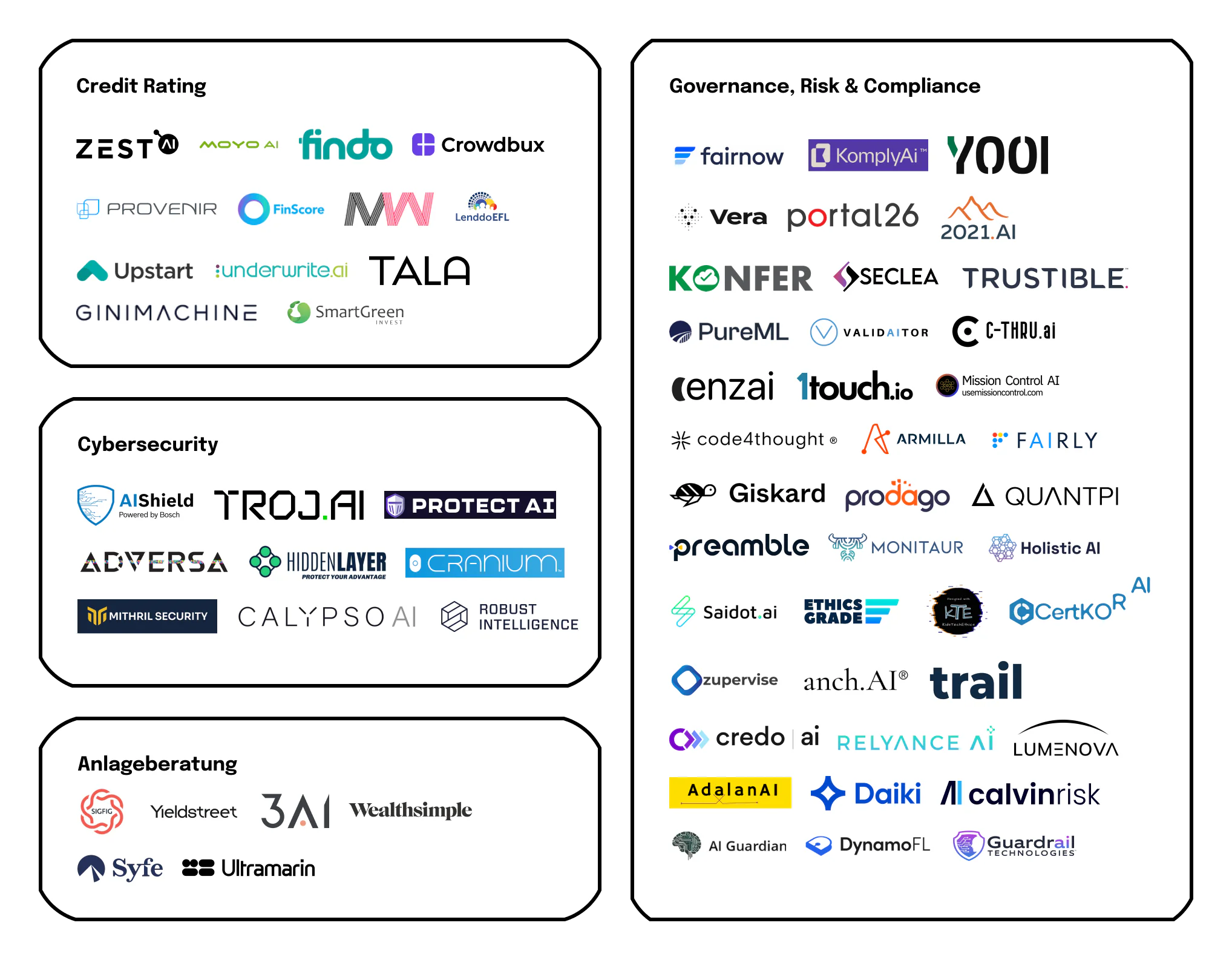

Die oben genannten Kategorien haben wir für eine grafische Visualisierung verdichtet. In der Start-up Map sind fast 70 innovative junge Unternehmen aufgeführt, die in diesem Bereich vertrauenswürdige KI einsetzen oder einzusetzen versuchen:

Aufbau ethischer Standards: Warum jedes Finanz-Start-up eine klare AI Richtlinie benötigt

Die obigen Beschreibungen der Bereiche und ihrer Risiken unterstreichen, wie wichtig es für Unternehmen ist, bei der Entscheidung für den Einsatz von künstlicher Intelligenz – speziell für eine vertrauenswürdige KI – zu optieren. Die Umsetzung ist weit kostenintensiver, als es häufig initial angenommen wird. Zudem mag der Einsatz von vertrauenswürdiger KI die Komplexität erhöhen und damit Umsetzungsgeschwindigkeit reduzieren. Die reine Behauptung, vertrauenswürdige KI zu implementieren, ohne das wirklich oder vollständig zu machen, ist ein typisches Beispiel für „KI-Washing“. Darüber hatte mein neosfer-Kollege, UI-/UX-Designer Luis Dille, kürzlich in seinem Beitrag „Generative KI im Banking: Zwischen Hype und Realität“ geschrieben.

Aus Investorensicht vertrete ich die Hypothese, dass Start-ups bereits im frühen Stadium damit beginnen sollten, ihre Governance an gängigen Richtlinien zu orientieren, um hierdurch längerfristige Effizienzgewinne zu erzielen. Es ist leichter „auf der grünen Wiese” eine Grundlage für eine robuste Governance zu schaffen und diese zu etablieren, als mit diesem Prozess erst in fortgeschrittener Unternehmensphase zu beginnen, da diese eine deutlich höhere Komplexität mit sich bringt. Zwar ist es stets ein schmaler Grad, Agilität und Governance-Frameworks in Einklang zu bringen, dennoch führt hierbei ein frühes Engagement mittel- bis langfristig oft zu höherer Kapitaleffizienz. Investoren belohnen diese Fortschrittlichkeit nämlich durchaus mit einer höheren Unternehmensbewertung.

Als Investor beobachten wir regelmäßig Signale von Unternehmen, um durch sie auf die Qualität eines potentiellen Investments zu schließen. Für die Aussagekraft des Signals ist wichtig, ob es mit einer kostspieligen oder weniger kostspieligen Maßnahme erzeugt wurde. Überträgt man diesen Ansatz auf den Einsatz vertrauenswürdiger KI bedeutet das: Wenn ein Unternehmen sich „verbal“ zu einer KI-Richtlinie verpflichtet, ist das ein wenig aussagekräftiges Signal, denn dieses Commitment kann das Start-up schon ohne großen Aufwand erreichen. Ein viel teureres Signal, auf das wir achten, ist der Nachweis, dass eine KI-Richtlinie auch tatsächlich umgesetzt wird.

Es gibt eine Reihe beobachtbarer Aspekte, die wir als kostspielige Signale werten: zum Beispiel wenn es eine fortlaufende Überprüfung von Datensätzen gibt, wobei diskriminierende Datenpunkte – das kann alles sein, vom Geschlecht bis zu Behinderungen oder Religionszugehörigkeit – regelmäßig entfernt werden. Dabei hilft ein heterogenes oder auf Diversität geschultes Team, das Aspekte wie verschiedene Geschlechter und Kulturen berücksichtigt. Das Aufstellen eines solchen Teams gestaltet sich in der Regel kostenintensiver. Zudem können Personalentscheidungen teuer werden, wenn bei Verstößen gegen eine KI-Richtlinie konsequent entlassen werden muss. Zudem muss ein Unternehmen sicherstellen, dass die Richtlinie auch auf Komponenten zutrifft, die durch Dritte (beispielsweise Zulieferer) zur Verfügung gestellt und in das Geschäft integriert werden.

Wirtschaftswissenschaftler James Bessen unterstützt diese These in seinem Researchpaper „The Role of Ethical Principles in AI Startups“. Er fasst zusammen, dass Investoren sich eher für Start-ups interessieren, wenn sie solche kostspieligen Maßnahmen ergreifen, als wenn sie einfach nur eine KI-Richtlinie haben.

Vertrauenswürdige künstliche Intelligenz als Wettbewerbsvorteil

Zusammenfassend lässt sich festhalten, dass die Prinzipien der vertrauenswürdigen KI in jedem Finanz-Start-up in der Frühphase angewendet oder entwickelt werden sollten. Es ist langfristig günstiger, das zu einem frühen Zeitpunkt im Lebenszyklus des Unternehmens zu tun. Denn dann ist die Organisation noch viel agiler. Zum anderen werden Start-ups, die sich frühzeitig und umfassend zu solchen KI-Standards bekennen – und diese auch umsetzen und damit compliant bleiben –, langfristig leichter Unternehmenskunden gewinnen. Es ist nämlich davon auszugehen, dass größere Unternehmen in Ausschreibungen immer häufiger entsprechende KI-Richtlinien zur Anforderung machen, um ihrerseits mit der zukünftigen Regulierung compliant zu sein.

Meine Hypothese ist deshalb, dass Start-ups, die vertrauenswürdige KI auch tatsächlich einsetzen, es leichter haben werden als andere, Finanzierung am Kapitalmarkt zu erhalten. Auf vertrauenswürdige KI zu setzen, ist zwar mit höherem Aufwand verbunden. Es stellt aber eine Investition dar, die sich bei Erfolg langfristig im Unternehmenserfolg auszahlt. Durch die Neuartigkeit des Themas gibt es jedoch sowohl in der Forschung, als auch in der Praxis noch signifikanten Bedarf für den Aufbau weiteren Know-Hows.

Gerade für neosfer als Frühphaseninvestor ist es daher wichtig, eigenes Know-how aufzubauen. Nur so können wir hypothesenbasierte, qualitative Investments in einem frühen Stadium und in einer Industrie tätigen, die sich – wie vertrauenswürdige KI – im Aufbau befindet. Dabei hilft uns unsere besondere Struktur als CVC (Corporate VC): neosfer besteht aus den drei Teams Invest, Build und Connect. Wir vom Team Invest können agil auf das Know-How des Teams Build zugreifen, wo meine Kolleginnen und Kollegen an eigenen KI-basierten Prototypen für unsere Muttergesellschaft, die Commerzbank, arbeiten. Wissen und Ergebnisse können wir teilen, was nicht nur uns im Team Invest hilft, sondern auch unseren Portfoliounternehmen.